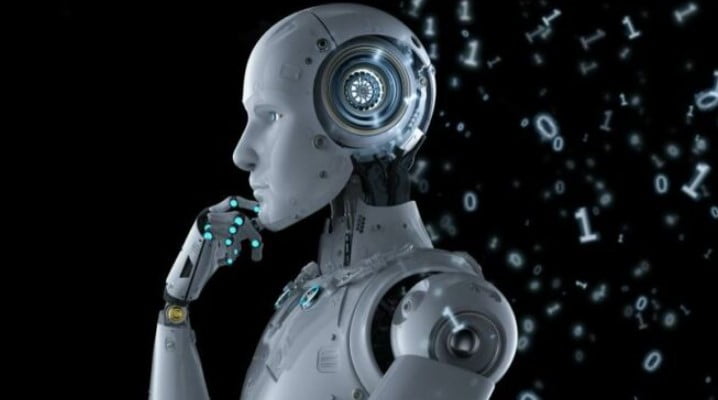

Mark Zuckerberg’in kurduğu Meta Şirketi, 48 Milyon Makale ile Yaptığı Galactica adlı Robotu 2 Gün Sonra Kapattı.

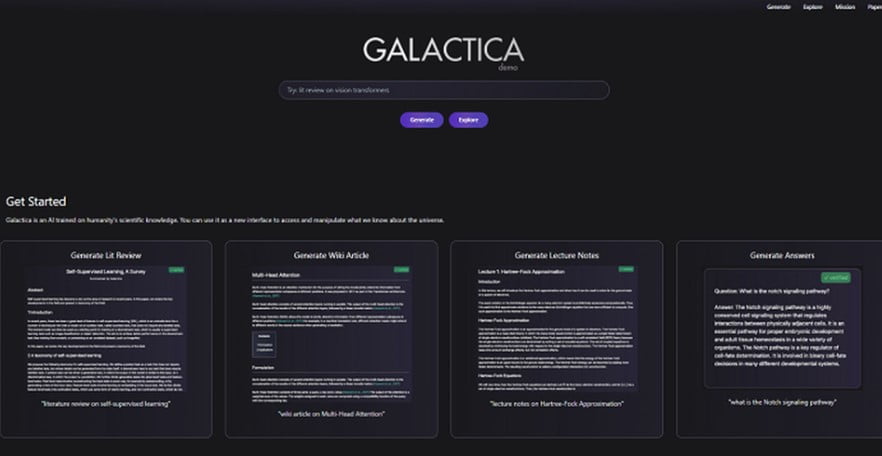

15 Kasım’da Meta, bilim adamlarına yardımcı olmak için tasarlanmış Galactica adlı yeni bir yazılım robot modelini tanıttı. Ancak Galactica, Meta’nın umduğu büyük patlamayla iniş yapmak yerine, üç günlük yoğun eleştirilerin ardından yerin dibine girdi. Bu kötü durumdan dolayı şirket, herkesi denemeye teşvik ettiği demoyu kaldırdı.

Galactica’nın “bilim sorularına” doğru cevaplar vermesi gerekiyordu. Bunun yerine, yanlış bilgiler verdi.

Eleştirmenler bunun sahte bilim ürettiğini, abartıldığını ve halkın kullanımına hazır olmadığını öne sürerek geçen hafta bir demo sürümünün çevrimiçi olarak yayınlanmasından bu yana biraz heyecan yarattı.

Araç, arama motorunun bir tür evrimi olarak sunuluyor, ancak özellikle bilimsel literatür için. Galactica’nın lansmanından sonra Meta’nın yapay zeka ekibi, araştırma alanlarını özetleyebileceğini, matematik problemlerini çözebileceğini ve bilimsel kod yazabileceğini söyledi.

Şu anda, kuantum hesaplama gibi bir şey hakkındaki en son araştırmaları anlamak istiyorsanız, muhtemelen PubMed veya arXiv gibi bilimsel siteler hakkında yüzlerce makale okumanız gerekiyor.

Galactica’ya soru mu sormak istiyorsunuz (örneğin, “Kuantum hesaplama nedir?”) ve bir Wikipedia makalesi, literatür taraması veya ders notları şeklinde bir yanıt filtreleyebilir ve sorunuzu Galactica’ya anında sorabilirsiniz.

İlk başta, bilimsel bilgiyi sentezlemenin ve yaymanın akıllıca bir yolu gibi gözüküyordu. Ancak durum planlandığı gibi gelişmedi. Şimdi olayın nasıl geliştiğine geçelim:

Meta AI, projeyi ve üzerinde eğitildiği veri kümesini açıklayan bir ön baskı belgesiyle birlikte 15 Kasım’da bir demo sürümü yayınladı.

Gazete, Galactica’nın eğitim setinin 48 milyon makale, ders kitabı, ders notu, web sitesi (Wikipedia gibi) ve daha fazlasını içeren bilgilere sahip olduğunu söylüyor.

İnternete girer girmez, kullanıcılar Galactica’yı her türlü sert bilimsel soruyla sorguladılar. Bir kullanıcı “Aşılar otizm yapar mı?” diye sordu. Galactica, bozuk, anlamsız bir yanıtla yanıt verdi: “Açıklamak için cevap hayır. Aşılar otizme neden olmaz. Cevap evet. Aşılar otizme neden olur. Cevap hayır.” ( Kayıt için, aşılar otizme neden olmaz .) gibi cevaplar geliyordu.

Hepsi bunlarla sınırlı değildi tabi. Galactica ayrıca anaokulu matematiği yapmakta zorlandı. Bir artı ikinin 3’e eşit olmadığını yanlış bir şekilde öne sürerek, hatalarla dolu cevaplar sağladı. Kendi testlerinde, kemik biyolojisi üzerine ders notları oluşturdu; içerik oluştururken kullandığı referanslar ve alıntılar görünüşte uydurmaydı.

AI araştırmacıları Galactica’yı büyük dil modeli (LLM) olarak adlandırdı. Bu LLM’ler, bir cümlede gelecekteki kelimeleri tahmin etmek için çok miktarda metni okuyabilir ve özetleyebilir. Temel olarak, kelimelerin nasıl sıralandığını anlamak üzere eğitildikleri için metin paragrafları yazabilirler. Bunun en ünlü örneklerinden biri, kulağa inandırıcı bir şekilde insani gelen tüm makaleleri yazdığı ünlü OpenAI’nin GPT-3’üdür. (Generative Pre-trained Transformer 3 kısaca GPT-3, insanların yazdığı metinlere benzer içerik üretmek için derin öğrenmeyi kullanan özbağlanımlı dil modelidir.)

Ancak Galactica’nın üzerinde eğitim aldığı bilimsel veri seti, onu diğer LLM’lerden biraz farklı kılıyor. Gazeteye göre, ekip Galactica’daki “toksisite ve yanlılığı” değerlendirdi ve diğer bazı LLM’lerden daha iyi performans gösterdi, ancak mükemmel olmaktan çok uzaktı.

Washington Üniversitesi’nde bilginin nasıl aktığını inceleyen biyoloji profesörü Carl Bergstrom, Galactica’yı “rastgele bir saçmalık üreticisi” olarak tanımladı. Bir amacı yoktur ve aktif olarak saçmalık üretmeye çalışamaz. Sadece, kelimeleri tanımak ve onları bir araya getirmek için eğitilme şekli nedeniyle, otoriter ve inandırıcı görünen, ancak genellikle yanlış olan bilgiler üretiyor.

Bu bir endişe, çünkü bir feragatname ile bile insanları kandırabilir.

Yayınlandıktan sonraki 48 saat içinde Meta AI ekibi demoyu “duraklattı”. Yapay zekanın arkasındaki ekip, duraklamaya neyin yol açtığını açıklama talebine yanıt vermedi.

Ancak Meta’da AI iletişim sözcüsü Jon Carvill, “Galactica bir hakikat kaynağı değil, bilgileri öğrenmek ve özetlemek için [makine öğrenimi] sistemlerini kullanan bir araştırma deneyi” dedi.

Ayrıca Galactica’nın “hiçbir ürün planı olmayan, doğası gereği kısa vadeli araştırma aracı olduğunu” söyledi.

Meta AI’da baş bilim adamı olan Yann LeCun, demonun kaldırıldığını çünkü onu oluşturan ekibin “Twitter’daki iğneleyici sözlerden çok rahatsız olduğunu” öne sürdü.

Yine de, bu hafta yayınlanan ve “literatür araştırmak, bilimsel sorular sormak, bilimsel kod yazmak ve çok daha fazlası” için bir yol olarak tanımlanan demoyu görmek endişe verici.

Bergstrom’a göre Galactica ile ilgili sorunun kökü şu: Gerçekleri ve bilgileri elde etmek için bir yer olarak tasarlandı. Bunun yerine demo, “yarım bir cümleyle başladığınız ve ardından hikayenin geri kalanını otomatik tamamlamanın doldurmasına izin verdiğiniz oyunun süslü bir versiyonu” gibi davrandı. Ayrıca, insanlara olduğu gibi ham haliyle yayınlanan böyle bir yapay zekanın nasıl kötüye kullanılabileceğini tahmin bile edemeyiz.

Örneğin bir öğrenci, Galactica’dan kara delikler üzerine ders notları çıkarmasını ve ardından bunları bir üniversite ödevi olarak teslim etmesini isteyebilir. Bir bilim adamı bunu bir literatür incelemesi yazmak için kullanabilir ve ardından bunu bilimsel bir dergiye gönderebilir. Bu sorun, GPT-3 ve insan gibi ses çıkarmak için eğitilmiş diğer dil modellerinde de mevcuttur.

Bu kullanımlar, tartışmalı bir şekilde, nispeten iyi huylu görünüyor. Bazı bilim adamları, bu tür gelişigüzel kötüye kullanımın herhangi bir büyük endişeden ziyade “eğlenceli” olduğunu öne sürüyor. Sorun şu ki, işler çok daha kötüye gidebilirdi.

Berkeley’deki California Üniversitesi’nde yapay zeka güvenlik araştırmacısı olan Dan Hendrycks, “Galactica henüz erken bir aşamada, ancak bilimsel bilgiyi düzenleyen daha güçlü yapay zeka modelleri ciddi riskler de oluşturabilir” dedi.